Link Cloaking

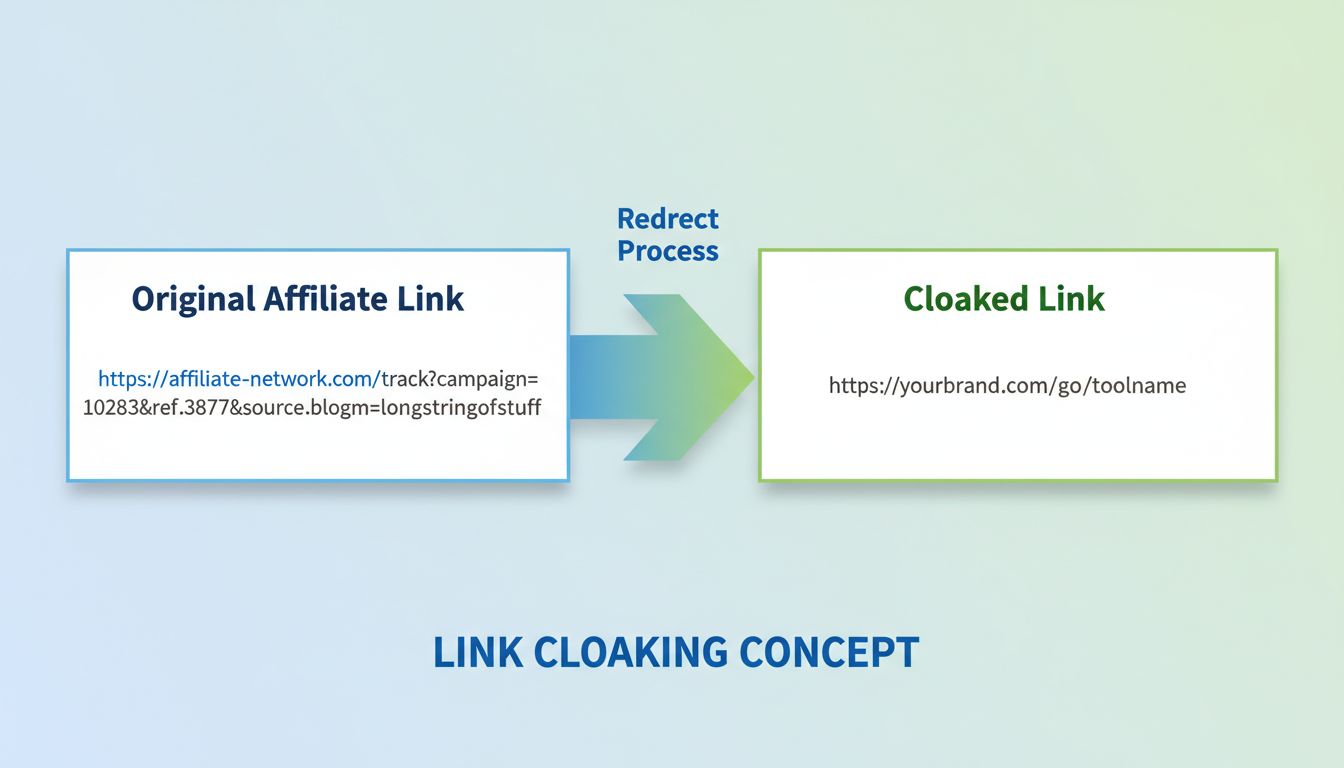

Link cloaking is een techniek die wordt gebruikt in affiliate marketing om de bestemmings-URL van affiliate links te verbergen, waardoor ze overzichtelijker, be...

Leer bewezen methoden om gecamoufleerde links te detecteren, waaronder HTML-inspectie, CSS-analyse, JavaScript-tests en SEO-tools. Een uitgebreide gids voor het vinden van verborgen links op websites.

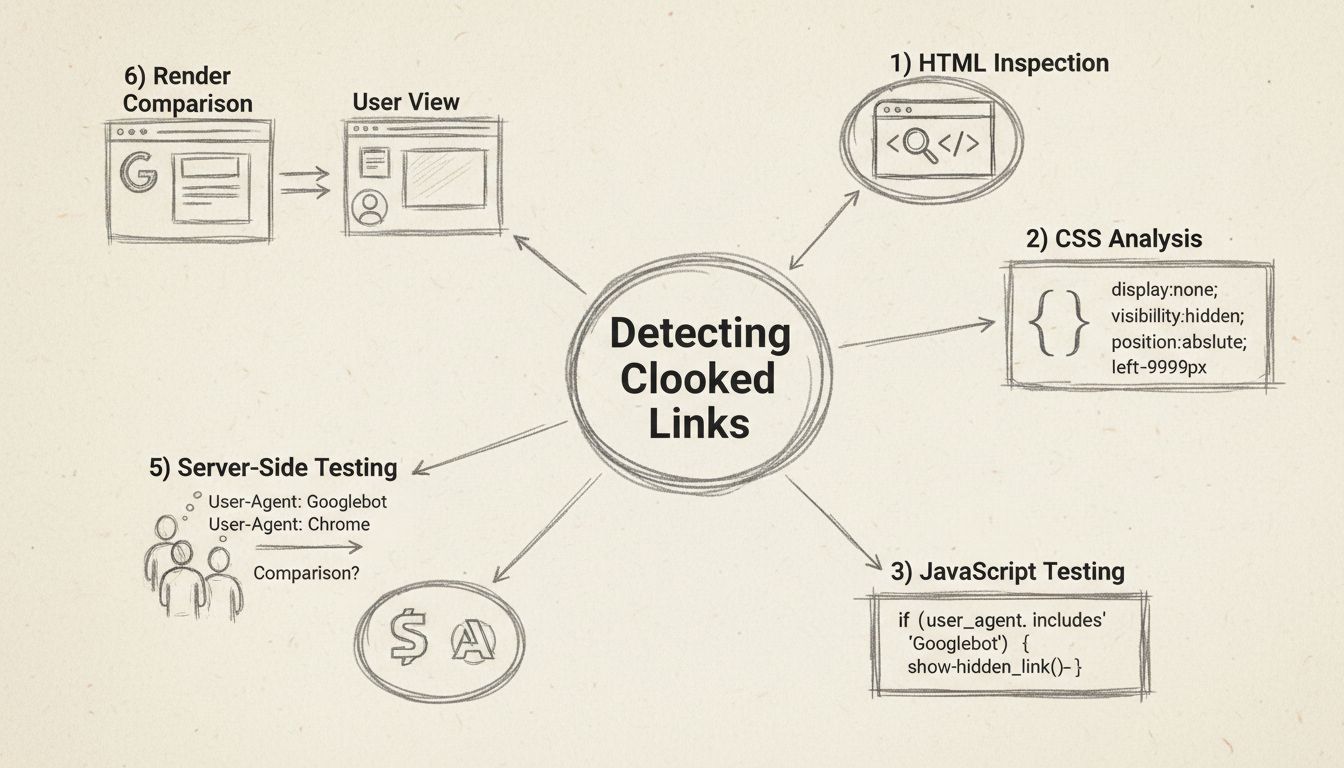

U kunt gecamoufleerde links vinden door de broncode van een website te bekijken, browserontwikkelaarstools te gebruiken om verborgen CSS-eigenschappen te inspecteren, JavaScript uit te schakelen om verborgen inhoud zichtbaar te maken, te vergelijken hoe Google pagina's weergeeft versus gebruikersweergaven, te testen met verschillende user-agents en professionele SEO-tools zoals Semrush, Ahrefs en Screaming Frog te gebruiken die verborgen of vermomde links detecteren.

Gecamoufleerde links zijn URL’s die hun werkelijke bestemming of inhoud voor gebruikers verbergen, terwijl ze mogelijk andere informatie tonen aan zoekmachines of andere bezoekers. Het vinden en identificeren van gecamoufleerde links is essentieel voor websitebeveiliging, SEO-naleving en het beschermen van uw affiliateprogramma tegen frauduleuze praktijken. Of u nu uw eigen website controleert, verdachte activiteiten onderzoekt of naleving van zoekmachinerichtlijnen waarborgt, weten hoe u gecamoufleerde links kunt detecteren is in 2025 een cruciale vaardigheid.

De meest fundamentele aanpak voor het vinden van gecamoufleerde links is het onderzoeken van de ruwe HTML-broncode van een webpagina. Wanneer u de paginabron bekijkt, ziet u de daadwerkelijke code die de server naar uw browser stuurt, wat vaak verborgen elementen onthult die niet zichtbaar zijn op de weergegeven pagina. Deze methode is bijzonder effectief omdat gecamoufleerde links ergens in de HTML-structuur moeten bestaan, zelfs als ze verborgen zijn via CSS- of JavaScript-styling.

Om de HTML-bron te inspecteren, klikt u met de rechtermuisknop op een webpagina en kiest u “Paginabron weergeven” of drukt u op Ctrl+U (Windows) of Cmd+U (Mac). Dit opent de ruwe HTML in een nieuw tabblad, waar u kunt zoeken naar verdachte patronen. Zoek naar ankertags (<a>-elementen) met href-attributen die verwijzen naar onverwachte bestemmingen. Veel gecamoufleerde links zijn verborgen met inline stijlen of CSS-klassen die eigenschappen voor het verbergen van zichtbaarheid toepassen. Zoek naar veelvoorkomende patronen zoals display:none, visibility:hidden, opacity:0 of position:absolute gecombineerd met extreem negatieve coördinaten zoals left:-9999px.

Browserontwikkelaarstools bieden nog krachtigere inspectiemogelijkheden. Druk op F12 om de ontwikkelaarstools te openen en gebruik vervolgens het tabblad Elementen of Inspector om individuele elementen op de pagina te bekijken. U kunt over elementen zweven om hun berekende stijlen te zien, wat onthult of CSS-eigenschappen inhoud verbergen. De DevTools tonen u ook de DOM-boomstructuur, zodat u alle elementen kunt zien, ook die niet visueel worden weergegeven. Dit is vooral handig om links te identificeren die technisch aanwezig zijn in de HTML, maar volledig onzichtbaar zijn voor gebruikers via CSS-manipulatie.

CSS-camouflage is een van de meest gebruikte technieken om links voor gebruikers te verbergen, terwijl ze toegankelijk blijven voor zoekmachines. Door de specifieke CSS-eigenschappen te begrijpen die voor camouflage worden gebruikt, kunt u verdachte patronen snel herkennen. De meest voorkomende CSS-camouflagetechnieken zijn onder andere witte tekst op een witte achtergrond, positionering buiten het scherm, elementen met nul-afmetingen en manipulatie van de dekking (opacity).

Bij camouflage met witte tekst op een witte achtergrond wordt de tekstkleur gelijkgemaakt aan de achtergrondkleur, waardoor de inhoud onzichtbaar is voor gebruikers maar nog steeds aanwezig in de HTML. U kunt dit detecteren door alle tekst op de pagina te selecteren (Ctrl+A) en te kijken of tekst zichtbaar wordt die dat eerder niet was. Positionering buiten het scherm gebruikt CSS-eigenschappen zoals position: absolute; left: -9999px; om inhoud ver buiten het zichtbare scherm te plaatsen. Camouflage met nul-afmetingen stelt width: 0; height: 0; of font-size: 0; in om elementen tot onzichtbare grootte te laten krimpen. Manipulatie van de dekking gebruikt opacity: 0; om elementen volledig transparant te maken terwijl ze in de DOM aanwezig blijven.

Gebruik systematisch uw browser-DevTools om deze technieken te detecteren, inspecteer verdachte elementen en controleer hun berekende stijlen. Let op elke combinatie van positionerings-, formaat- of kleurinstellingen die inhoud onzichtbaar zouden maken. Veel legitieme websites gebruiken vergelijkbare technieken voor toegankelijkheidsdoeleinden (zoals het verbergen van “skip-to-content”-links), dus de context is belangrijk. Wanneer deze technieken echter worden gecombineerd met met zoekwoorden gevulde tekst of links naar niet-gerelateerde domeinen, duidt dat op camouflage. De transparante aanpak van PostAffiliatePro voor linkbeheer zorgt ervoor dat al uw affiliatelinks legitiem zijn en voldoen aan de richtlijnen van zoekmachines, waardoor deze misleidende praktijken volledig worden vermeden.

Camouflage op basis van JavaScript wordt steeds geavanceerder, omdat het dynamisch verborgen links of inhoud kan injecteren nadat de pagina is geladen. Dit type camouflage is bijzonder lastig te detecteren omdat de verborgen inhoud niet in de oorspronkelijke HTML-broncode verschijnt. Om camouflage op basis van JavaScript te identificeren, moet u vergelijken hoe de pagina eruitziet met JavaScript ingeschakeld versus uitgeschakeld.

Schakel JavaScript uit in uw browserinstellingen en laad de pagina opnieuw om te zien welke inhoud door JavaScript wordt verborgen. De meeste browsers laten u JavaScript uitschakelen via ontwikkelaarsinstellingen of extensies. Als er belangrijke inhoud of links verschijnen wanneer JavaScript is uitgeschakeld die eerder niet zichtbaar waren, duidt dit op JavaScript-camouflage. Bekijk daarnaast de JavaScript-code zelf door het tabblad Bronnen in DevTools te controleren. Zoek naar code die de user-agent detecteert (de identificatie die aan websites vertelt welke browser of bot de pagina bezoekt) en verschillende inhoud toont op basis van die detectie.

Veelvoorkomende JavaScript-camouflagepatronen zijn onder meer het controleren op Googlebot-user-agents en het tonen van verschillende inhoud aan zoekmachines, het detecteren van mobiele versus desktopbrowsers en het tonen van verschillende pagina’s, of detectie op basis van referrer om verschillende inhoud te tonen afhankelijk van waar de gebruiker vandaan komt. U kunt de paginabron doorzoeken naar verdachte JavaScript-patronen zoals navigator.userAgent, User-Agent of conditionele instructies die zoeken naar bot-identificaties. Het tabblad Netwerk in DevTools toont ook alle aanvragen die door de pagina worden gedaan en laat zien of extra bronnen voorwaardelijk worden geladen op basis van de user-agent of andere factoren.

Een van de meest effectieve manieren om camouflage te detecteren is door te vergelijken hoe een pagina eruitziet voor gebruikers versus hoe zoekmachines deze zien. Google biedt officiële tools voor dit doel, waardoor het eenvoudig is om verschillen te identificeren. De Google Search Console URL-inspectietool toont precies hoe Googlebot een specifieke URL weergeeft en indexeert, zodat u deze kunt vergelijken met wat u als gewone gebruiker ziet.

Gebruik deze methode door Google Search Console te openen, naar de URL-inspectietool te navigeren en de URL in te voeren die u wilt controleren. Google toont u de gerenderde HTML die Googlebot ziet, inclusief alle via JavaScript weergegeven inhoud. Vergelijk dit met wat u normaal ziet bij het bezoeken van de pagina. Als de gerenderde versie andere inhoud, links of metadata toont dan wat gebruikers zien, duidt dit op camouflage. Let vooral op verschillen in paginatitels, metabeschrijvingen, kopinhoud en het aantal aanwezige links.

De Google Rich Results Test biedt een ander perspectief en toont hoe de gestructureerde dataparser van Google uw pagina interpreteert. Dit is handig voor het detecteren van camouflage in schema-markup of gestructureerde data. Daarnaast kunt u browser-DevTools gebruiken om de initiële HTML (Bron weergeven) te vergelijken met de weergegeven DOM (Elementen-tab na uitvoering van JavaScript). Klik met de rechtermuisknop en selecteer “Paginabron weergeven” om de ruwe HTML te zien, open vervolgens de DevTools en inspecteer het tabblad Elementen om de uiteindelijke weergegeven staat te zien. Grote verschillen tussen deze twee weergaven duiden op JavaScript-gebaseerde contentinjectie of camouflage.

Server-side camouflage houdt in dat de webserver verschillende inhoud levert op basis van de kenmerken van het verzoek, met name de user-agent header. Dit is een van de meest misleidende camouflagetechnieken omdat het gebeurt voordat de browser de inhoud überhaupt ontvangt. Om server-side camouflage te detecteren, moet u verzoeken doen naar dezelfde URL met verschillende user-agents en de reacties vergelijken.

Gebruik opdrachtregeltools zoals cURL of Postman om verschillende user-agents te testen. U kunt bijvoorbeeld een verzoek doen met een gewone browser-user-agent en dit vergelijken met een verzoek met de Googlebot-user-agent. De commando’s zien er als volgt uit:

curl -H "User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com

curl -H "User-Agent: Mozilla/5.0 (compatible; Googlebot/2.1)" https://example.com

Vergelijk de reacties op grootte, inhoud, HTTP-statuscodes en metadata tussen deze verzoeken. Als de reacties aanzienlijk verschillen, levert de server waarschijnlijk andere inhoud op basis van de user-agent, wat een vorm van camouflage is. Controleer daarnaast op heimelijke redirects die alleen voor bepaalde user-agents plaatsvinden. Sommige sites leiden mobiele gebruikers om naar spamsites terwijl ze legitieme inhoud tonen aan desktopgebruikers, of leiden zoekmachinegebruikers om naar legitieme inhoud terwijl gewone gebruikers elders naartoe worden gestuurd.

Analyseer uw serverlogs om patronen te identificeren waarbij verschillende inhoud wordt geleverd aan verschillende user-agents. Let op verzoeken van Googlebot die andere antwoorden krijgen dan identieke verzoeken van gewone browsers. Controleer of verzoeken die beweren van Googlebot te komen daadwerkelijk van Google’s IP-reeksen afkomstig zijn via reverse DNS lookup. Vertrouw niet alleen op de user-agent header, want deze kan eenvoudig worden vervalst. Kruis het bron-IP-adres met de gepubliceerde IP-reeksen van Google om echte Googlebot-verzoeken te bevestigen.

| Toolnaam | Type | Primaire functie | Beste voor |

|---|---|---|---|

| Google Search Console | Officieel | URL-inspectie & renderanalyse | Vergelijken van Google’s weergave vs. gebruikersweergave |

| Google Rich Results Test | Officieel | Validatie van gestructureerde data | Detecteren van gecamoufleerde schema-markup |

| Screaming Frog SEO Spider | Derde partij | HTML-crawling & vergelijking | Vergelijken van weergegeven vs. bron-HTML |

| Semrush Site Audit | Derde partij | Inhoudsanalyse & camouflage-detectie | Identificeren van verborgen inhoudspatronen |

| Ahrefs Site Audit | Derde partij | Analyse van inhoudsverschillen | Vinden van inhoudsverschillen |

| Browser DevTools | Ingebouwd | HTML/CSS/JavaScript-inspectie | Handmatige elementinspectie |

| cURL/Postman | Opdrachtregel | User-agent testen | Server-side camouflage-detectie |

| Lighthouse | Ingebouwd | Pagina kwaliteitscontrole | Rendering- en prestatieproblemen |

Professionele SEO-tools zoals Semrush en Ahrefs hebben ingebouwde functies voor camouflagedetectie die automatisch uw site scannen en de inhoud vergelijken die aan verschillende user-agents wordt geleverd. Screaming Frog SEO Spider is bijzonder handig voor het crawlen van volledige websites en het vergelijken van de weergegeven HTML met de bron-HTML, waardoor het eenvoudig is om verschillen op honderden pagina’s te detecteren. Deze tools besparen aanzienlijk veel tijd ten opzichte van handmatig testen en kunnen camouflageproblemen identificeren die u mogelijk mist met basale inspectiemethoden.

Het onderscheid kennen tussen legitiem linkbeheer en camouflage is cruciaal voor het behouden van naleving met zoekmachinerichtlijnen. Legitieme praktijken zijn onder meer het gebruik van JavaScript om inhoud weer te geven die zichtbaar is voor zowel gebruikers als zoekmachines, server-side rendering waarbij identieke inhoud aan alle bezoekers wordt getoond, responsive design dat zich aanpast aan verschillende apparaten terwijl dezelfde inhoud wordt getoond, en het toepassen van betaalmuren waarbij zoekmachines de volledige inhoud kunnen zien zoals geautoriseerde gebruikers.

Misleidende praktijken die camouflage vormen zijn onder andere het tonen van verschillende URL’s of inhoud op basis van de user-agent, het uitsluitend aan zoekmachines tonen van met zoekwoorden gevulde inhoud, het omleiden van zoekmachinegebruikers naar andere pagina’s dan gewone gebruikers en het verbergen van inhoud met CSS of JavaScript met als doel zoekmachines te misleiden. Het spambeleid van Google verbiedt camouflage expliciet en kan leiden tot handmatige acties, rankingstraffen of volledige verwijdering uit de zoekresultaten. PostAffiliatePro onderscheidt zich als de beste affiliate softwareoplossing omdat het transparant en legitiem linkbeheer biedt zonder enige camouflage of misleidende praktijken, zodat uw affiliateprogramma compliant en betrouwbaar blijft.

Voer een systematische aanpak uit om gecamoufleerde links te detecteren door deze stapsgewijze workflow te volgen. Voer eerst een eerste inspectie uit door de paginabron te bekijken, browser-DevTools te gebruiken om elementen te inspecteren en te controleren op verborgen CSS-eigenschappen. Vergelijk vervolgens de rendering door de Google URL-inspectietool te gebruiken, weergegeven HTML te vergelijken met bron-HTML en te zoeken naar inhoudsverschillen. Test ten derde JavaScript door JavaScript uit te schakelen en de pagina opnieuw te laden, de DevTools-console te controleren op bot-detectiecode en zichtbare inhoud te vergelijken met en zonder JavaScript ingeschakeld.

Voer ten vierde user-agent testen uit door cURL of Postman te gebruiken om verschillende user-agents te testen, de grootte en inhoud van reacties te vergelijken en te controleren op voorwaardelijke redirects. Analyseer ten vijfde serverlogs door patronen te bekijken van verschillende inhoud die aan verschillende user-agents wordt geleverd, te letten op verdachte IP-adressen en te zoeken naar snelle verzoeken van bot-achtige user-agents. Gebruik ten slotte geautomatiseerde scans met professionele SEO-tools zoals Semrush, Ahrefs of Screaming Frog om verborgen inhoud op uw gehele website te detecteren. Deze uitgebreide aanpak zorgt ervoor dat u zowel voor de hand liggende als geavanceerde camouflagepogingen opspoort.

Regelmatige monitoring is essentieel in 2025, nu camouflagetechnieken zich blijven ontwikkelen. Voer kwartaalcontroles uit van uw website en affiliatelinks om voortdurende naleving te garanderen. Stel meldingen in Google Search Console in om u te waarschuwen voor handmatige acties of indexeringsproblemen die op camouflage kunnen duiden. Gebruik de ingebouwde compliance-functies van PostAffiliatePro om ervoor te zorgen dat al uw affiliatelinks transparant en legitiem zijn, zodat u de reputatie van uw programma en uw zoekmachinerangschikkingen beschermt.

PostAffiliatePro biedt transparant, legitiem linkbeheer en tracking zonder camoufleren of misleidende praktijken. Beheer uw affiliateprogramma met volledige transparantie en naleving.

Link cloaking is een techniek die wordt gebruikt in affiliate marketing om de bestemmings-URL van affiliate links te verbergen, waardoor ze overzichtelijker, be...

Leer wat link cloaking doet, hoe het werkt, legitieme toepassingen in affiliate marketing en best practices. Ontdek waarom PostAffiliatePro de beste keuze is vo...

Ontdek de optimale frequentie voor het controleren van uitgaande links in 2025. Leer meer over kwartaal-, maandelijkse en jaarlijkse controleschema's op basis v...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.